”エンゲージメントを得られている”…「SHOWROOM VR」のDeNAが提示する360度動画の基礎知識【CEDEC 2016】

パシフィコ横浜で開催された「Computer Entertainment Developers Conference 2016(CEDEC2016)」最終日。「360度動画の基礎知識:魚眼レンズの歪曲補正とリアルタイム・イメージ・スティッチングについて」と題するCEDEC2016最後のセッションが行われた。講師は株式会社DeNAシステム本部技術開発室の小倉豪放氏。これまで『バーチャファイター』や『シェンムー』に携わり、現在は「SHOWROOM VR」の立ち上げを行う。また、同氏はCEDECの運営委員でもある。

▲小倉豪放氏

■スティッチングと「SHOWROOM VR」について

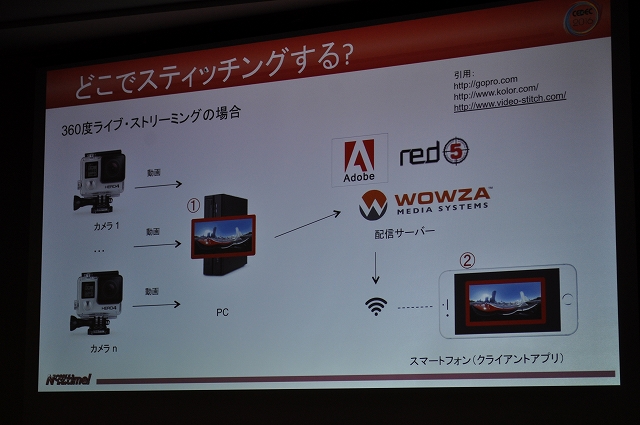

生映像を結合、組み合わせるイメージスティッチング。360度動画の場合はカメラで撮影した映像を集めてきてPCで行う。(使用ソフトはAutopano Video、Video Stichなど)

360度ライブ・ストリーミングの場合はカメラからPCでスティッチングすると小倉氏。例えば「SHOWROOM VR」は自分で配信する事を想定していたため、Adobe FMS、red5、WOWZAなどの配信サーバーからスマートフォンなどのクライアントアプリに、という流れとなる。

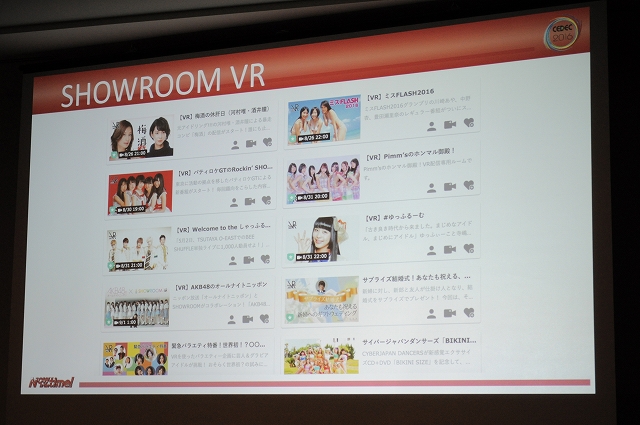

小倉氏は5月に開始された360度ライブストリーミングサービス「SHOWROOM VR」での映像を一例に挙げ、グラビアアイドルなどのVRストリーミング動画に対して、アイテムを投げたり星を投げたりできる事を説明。「こういったキワモノから開始して、今ではAKBなどのVR動画も配信している」という。

これら一つのコンテンツだけでも2万のユーザーがいるので、VRコンテンツだけでもかなりのビューがあるとデータから読み取れた。また同じコンテンツ上においてVRと通常配信での「投げられているアイテムの差」を調べたところ、VRの方が多いという。「そういった側面からも、エンゲージメントを得られている」と同氏。没入間やリアリティで、VRコンテンツとユーザー間のつながりは通常の映像より高く需要も多そうだ。

ライブストリーミング動画の場合リアルタイムでスティッチングする必要があるため、次項では「RICOH ThetaS」を用いた実例での説明がなされた。

■魚眼レンズの歪曲補正とリアルタイムイメージスティッチング

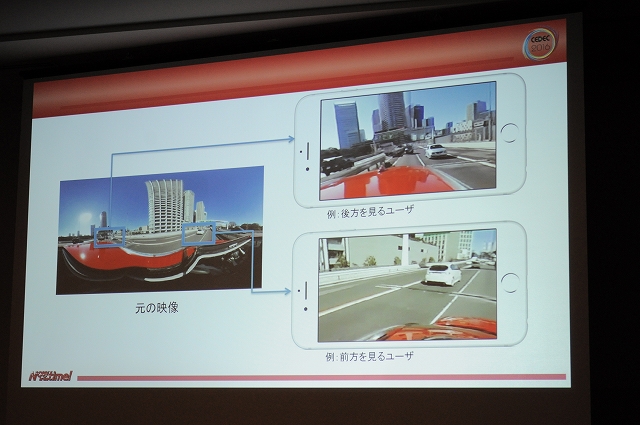

主要なVRコンテンツは360度動画や360度ストリーミングなどであり、これらにはリアルタイムイメージスティッチングが必要である。360度カメラで撮影した生の映像は円形の魚眼映像であり、これを正距円筒図法に変換、映像を丸めて360度映像を作り出す事で360度の映像となる。

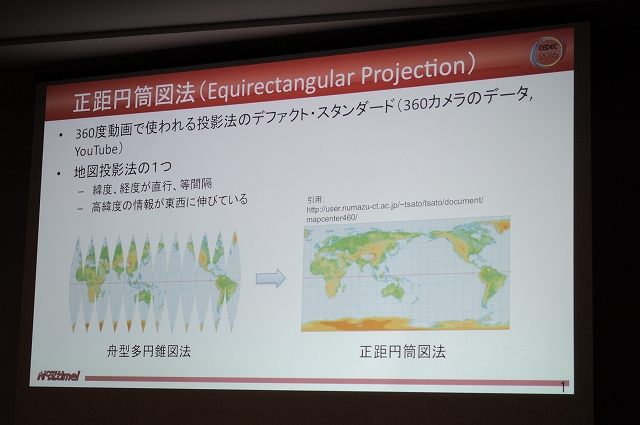

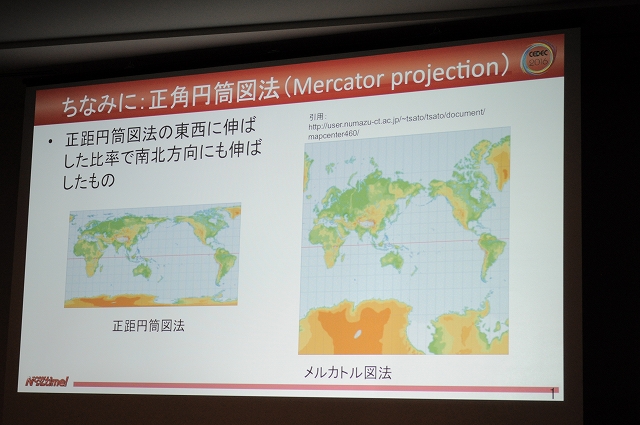

UV値は頂点座標から計算する事も可能だ。この正距円筒図法は360度動画で使われる投影法のデファクトスタンダード。緯度経度が直行、等間隔に並んで高緯度の情報が東西に伸びている。ちなみに正角円筒図法(メルカトル図法)は「正距円筒図法の東西に伸ばした比率で南北方向にも伸ばしたもの」となる。

ここで重ねて挙げられたのが、「360度カメラで投影した映像がそのまま正距円筒図法というわけではない」という事。生の映像はレンズの数だけ映像が分かれていて、それを違和感なく結合する事がスティッチングとなる。スティッチングして正距円筒図法にすると360度映像として再生できるデータになるので、カメラ会社などが提供するPCアプリ、スマホアプリを用いて変換を行い360映像にする。まとめると、生の映像を正距円筒図法へと変換し、それを球体の平面上に貼り付けて360度の映像コンテンツとする事となる。

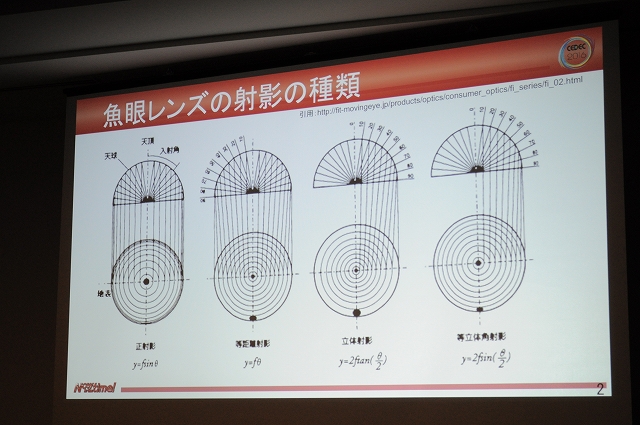

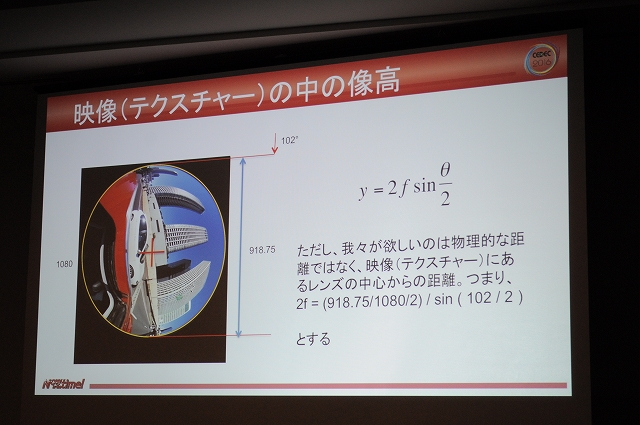

続いて、小倉氏は魚眼レンズの射影についての解説を行った。魚眼レンズの射影の種類ごとに、正射影:y=fsinθ、等距離射影:y=fθ、立体射影:y=2ftan(θ/2)、等立体角射影:y=2fsin(θ/2)となっていて、それぞれの方式に従って像高が求められる。ここでカタログデータではなく小倉氏自ら算出した数値を例に解説。視野角204、射影方式は等立体角射影、入射角は0<θ<102、左右のレンズ性能は同じで、像高は結像面でのレンズ中心からの物理的な距離y=2fsin(θ/2)(fは焦点距離)。映像のテクスチャーにある中心からの距離が必要であるため、数式は2f=(918.75/1080/2)/sin(θ/2)とする。

小倉氏は「像の一番外側にあるデータは何かと考えた時に、それは102°この円で得られる最大のものが像の外側にかかれている。θに102を入れた時に、丁度テクスチャーの同位置の数値を取ってくるように2fを調整すればいいという事になります」と語った。(実際のShaderのコードと直値は画像を参照)

またDual Fisheyeと正距円筒図法の映像に彩色して「個々のレンズの映像がEquirectangulatarのどの部位に貢献しているか」を比較したデモ映像や、「Little Planet」でのエフェクトについても映像で説明した。

本項でのまとめは、「360度カメラで撮影した生の映像は、レンズの数だけ映像が分かれている。それらの分かれている映像の結合をスティッチングと呼ぶ」という事と、「スティッチングして正距円筒図法にする」事、そして「魚眼レンズは仕様・射影法を調べて、像高を計算する」事の3つとなる。

■PCでやる意味

オール・イン・ワンの撮影器材として「NOKIA OZO」「GoPro LiveVR」「RICOH ThetaS」など選択肢は少ない。またNOKIAで600万、その他で60万~数十万ほどにもなる。

さらに、様々なアルゴリズムを挟めるというメリットでは、スティッチングした映像はGPUにある(例:美白など)、ライブストリーミングの場合の後工程はエンコード・重要でない方角の色数を減らし圧縮効率を高める、両眼視差に対応できるといった点を挙げた。

一転落とし穴についても触れ、キャプチャーボードからビデオボードまでのデータ転送について、システムメモリへのコピーをせずにGPUへDMA転送するためにワークステーション専用GPUが必要だが、それはとても高価である事も付け加えた。

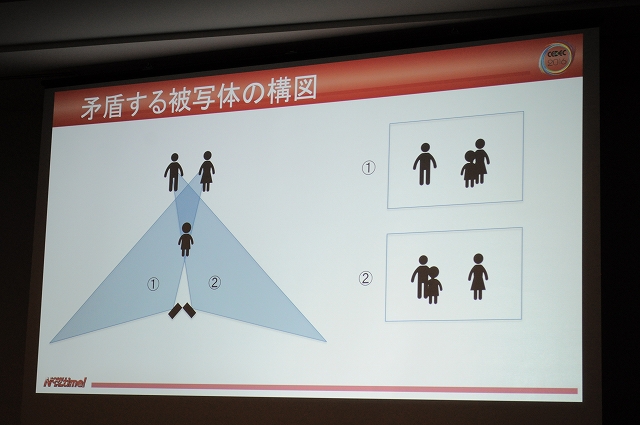

また、スティッチングを全自動化する事は難しく、例えば地点A・B、2つのカメラで撮影した映像自体に矛盾が発生するため、機械的な合成ではなく感覚的な手作業が必要になってくる事にも触れた。

○本項の総括とこれから

PCでカメラシステムを組む利点は、様々なアルゴリズムが使えるところ。欠点は高価になってしまうというところである。機材の世代交代は、2016年の秋から2017年初頭、CES2017にかけてだと小倉氏。CESにて発表される新製品に期待が高まりそうだ。

また、今後はリアルタイムスティッチング機能搭載カメラやリアルタイムスティッチングSDKの充実が見込めるため、ハードウェア/ソフトウェアともに業界全体の隆盛につながっていくだろう。ただしスティッチングの全自動化は難しく、手作業は必ず残る。映像が精細になればなるほどなくてはならない要素になっていくようで、より高度な技術が求められる事をにおわせて、CEDEC2016における全てのプログラムは終了した。

(取材・文:ライター 平工泰久)

会社情報

- 会社名

- 株式会社ディー・エヌ・エー(DeNA)

- 設立

- 1999年3月

- 代表者

- 代表取締役会長 南場 智子/代表取締役社長兼CEO 岡村 信悟

- 決算期

- 3月

- 直近業績

- 売上収益1349億1400万円、営業利益42億0200万円、税引前利益135億9500万円、最終利益88億5700万円(2023年3月期)

- 上場区分

- 東証プライム

- 証券コード

- 2432